Foundation agent, 인간의 뇌를 닮은 AI 탄생 배경과 철학적 기원을 알아봄으로써 AI가 어떻게 인간처럼 생각하고 행동하게 되었을지 알아봅니다. LLM의 진화, 뇌에서 영감을 받은 에이전트 설계까지 ADVANCES AND CHALLENGES IN FOUNDATION AGENTS 논문의 chapter 1에 해당하는 내용을 알아봅니다.

Foundation Agent? 인간의 뇌를 닮은 AI의 탄생 배경과 철학

인공지능(Artificial Intelligence, AI)은 단순한 기술 진보가 아닙니다. 고대 신화부터 르네상스의 기계인간, 그리고 오늘날 LLM(대형 언어모델)에 이르기까지, 인간은 오랫동안 ‘스스로 생각하고 행동하는 존재’를 꿈꿔왔습니다.

논문 [Advanced and Challenges in Foundation Agents]의 Chapter 1을 바탕으로, Foundation Agent라는 개념이 어떻게 태어났고, 어떤 과학적 구조 위에 세워졌는지에 대해 깊이 있게 살펴보겠습니다.

1. 고대 신화부터 시작된 ‘생각하는 기계’의 꿈

Foundation Agent의 철학적 뿌리는 고대 그리스 신화 속 탈로스(Talos)에서 찾을 수 있습니다. 청동으로 만들어진 거대한 인공 존재가 섬을 지킨다는 이 이야기는, 인간이 이미 수천 년 전부터 목적을 가지고 자율적으로 행동하는 존재를 상상해 왔음을 보여줍니다.

르네상스 시대에는 레오나르도 다빈치가 인간 해부학을 기반으로 한 기계 인간을 설계하기도 했습니다. 그리고 마침내 1950년, 컴퓨터 과학자 앨런 튜링이 “기계는 생각할 수 있는가?”라는 질문을 던지며 AI의 과학적 여정을 시작했습니다. 그가 제안한 튜링 테스트는 오늘날까지도 ‘기계지능’의 대표적 판별 기준으로 남아 있습니다.

2. 인간을 닮은 AI: Foundation Agent의 정의

초기의 AI는 논리 규칙 기반의 기호주의(symbolic AI)였으며, 문제 해결 능력은 있었지만 환경 변화에 유연하게 대응하지는 못했습니다. 그러던 중, 로드니 브룩스(Rodney Brooks)는 섭섬션 아키텍처(subsumption architecture)라는 구조를 제안하며, 실시간 반응이 가능한 에이전트 개념을 현실로 이끌었습니다.

Foundation agent에 대한 정의는 단순한 챗봇을 넘어서, 지능적 사회적 존재로서의 AI 설계 철학을 담고 있습니다. 에이전트(agent)는 단순 정보 처리기가 아닌, 환경을 인지하고(perceive), 판단하며(cognition), 자율적으로 행동(action)하며, 다른 에이전트와 협력하는 시스템으로재정의되었고, 지금은 자율주행차, 대화형 비서, 로봇 등 다양한 영역에서 실제 구현되고 있습니다.

Foundation Agent의 핵심 5가지

- 다중 모달 지각(Perception): 텍스트, 이미지, 센서 등 다양한 입력을 감지

- 인지 적응(Cognition): 감정, 목표, 기억 등을 기반으로 자기 최적화

- 자율적 추론 및 계획(Reasoning & Planning): 단기/장기 목표에 따른 전략 수립

- 목적 지향 행동 생성(Action): 물리적/디지털 행동 모두 가능

- 협업 구조(Multi-agent): 공동 목표를 위해 팀을 구성하고 역할 분담

3. LLM과 함께 도약한 Foundation Agent

최근 ChatGPT, Claude, DeepSeek 등 LLM 기반 AI가 등장하면서, 에이전트는 한 단계 더 진화했습니다.

이전에는 명령에 따라 정해진 작업만 수행했으나, 현재는 자연어를 이해하고, 외부 도구를 호출하며, 인간처럼 추론하고 협업이 가능합니다. 특히 함수 호출(Function Calling)과 Zero-shot/Few-shot 학습 능력 덕분에, LLM 기반 에이전트는 문맥을 이해하고 도구를 직접 활용하여 실시간 문제 해결까지 가능하게 되었습니다. 이는 기존의 제한적인 규칙 기반 시스템과는 전혀 다른 차원의 ‘지능’을 의미합니다.

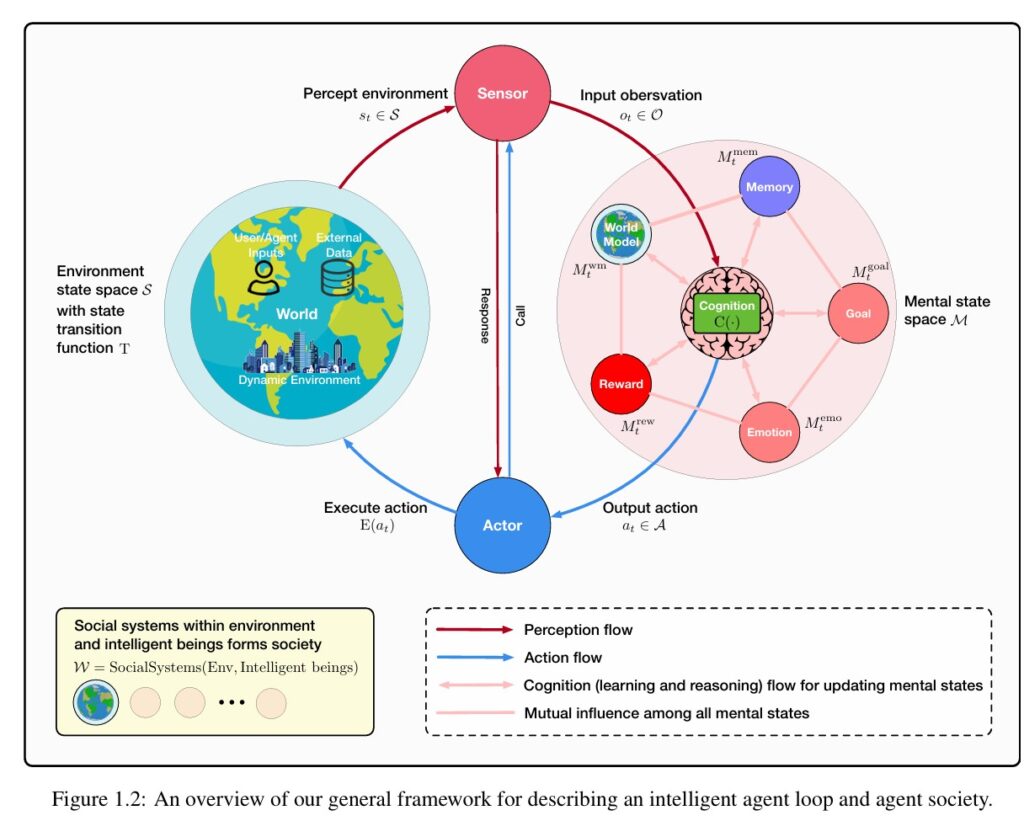

이 다이어그램은 Foundation Agent가 세상과 어떻게 상호작용하는지를 보여주는 핵심 프레임워크로 주요 구성요소는 아래와 같습니다. 이 구조는 인간의 뇌가 감각→판단→행동→피드백을 반복하며 적응하는 방식과 유사하며, Foundation Agent 설계의 뇌 기반 논리를 잘 보여줍니다.

- 환경(World) : 사용자, 데이터, 물리 세계가 포함된 외부 세계

- 센서(Sensor) : 외부 환경으로부터 감각 정보 수집

- 지각 & 인지 (Perception & Cognition) : 감지된 정보를 바탕으로 내부 상태(기억, 감정, 목표 등)를 갱신하고 판단

- 행위자(Actor): 결정된 행동을 외부에 실행 (예: 말하기, 움직이기, 도구 사용)

- 지속적 루프: 위 과정이 반복되며 학습이 이루어짐 (자기강화적 루프 구조)

4. 인간 두뇌와 AI는 얼마나 닮았을까?

논문은 흥미롭게도 인간 뇌와 Foundation Agent의 기능을 비교합니다. 특히 전두엽(계획과 추론), 후두엽(시각 처리), 측두엽(언어와 기억) 등 뇌의 전문 기능이 AI 모듈 설계에 반영되고 있다는 점은 Foundation Agent 설계의 생물학적 영감을 잘 보여줍니다.

| 기능 영역 | 인간의 뇌(생물학적) | AI (LLM 기반) |

| 학습 방식 | 지속적, 상호작용 기반 | 사전 학습 기반, 오프라인 |

| 감정 | 있음 | 없음 |

| 창의성 | 경험기반 창의력 | 통계적 조합 |

| 에너지 효율 | 매우 높음 | 매우 낮음 (GPU등 고비용) |

| 자기 인식 | 있음 | 미흡 |

5. 뇌에서 영감 받은 AI 프레임워크

논문은 “뇌의 작동 방식에서 영감을 받은 AI 설계”를 제안합니다. 이 프레임워크는 다음과 같은 구성 원칙을 따릅니다:

– 다중 모달 입력과 병렬 처리 (Perception)

– 모듈화된 인지 처리 시스템 (Cognition)

– 보상 및 감정 기반 강화 학습 (Reward/Emotion)

– 목표 설정과 도구 사용 계획 수립 (Goal-based Planning)

각 기능은 실제 뇌의 영역과 연결됩니다. 예를 들어, Memory는 해마, Reasoning은 전전두엽, Emotion은 변연계와 대응됩니다.

6. AI의 사회성과 예측성

Foundation Agent는 단순히 뇌 기능을 흉내 낸 것이 아닙니다. 그 이면에는 다음과 같은 이론적 기반이 있습니다. 이러한 이론들은 Foundation Agent가 자기 주도적, 예측 기반, 다중 모달 적응형 시스템으로 진화하도록 이끌고 있습니다.

– Minsky의 Society of Mind: 다양한 인지 기능을 분산된 소에이전트로 분리

– Buzsáki의 Inside-Out 이론: 외부 자극이 아니라 내부 상태가 지각을 주도

– Active Inference: 뇌는 끊임없이 예측을 통해 행동을 조절함

Foundation Agent는 AI의 다음 진화 단계

이제 AI는 ‘의도를 가진 존재’로 진화하고 있습니다. 논문 Advanced and Challenges in Foundation Agents 서론 부분은 Foundation Agent의 탄생 배경과 철학, 생물학적 비교, 그리고 새로운 설계 패러다임까지 폭넓게 다루고 있습니다. 인간처럼 느끼고, 생각하고, 배우며, 협업할 수 있는 AI. 그것이 바로 우리가 향하고 있는 Foundation Agent의 미래입니다.

[참고 자료]

Foundation Agent? 인간처럼 생각하고 행동하는 AI의 5가지 핵심 모듈 – 모두의 팬! MOFAN

– Advanced and Challenges in Foundation Agents

– Turing, A. M. (1950). Computing Machinery and Intelligence, Mind

– Brooks, R. A. (1986). A Robust Layered Control System for a Mobile Robot

– LeCun, Y., Bengio, Y., & Hinton, G. (2015). Deep Learning, Nature